Richting een betere technische oplossing voor coreferentie in taal

Een belangrijk en uitdagend vraagstuk binnen Natural Language Processing is coreference resolution (coreferentie). Coreferentie is in simpele woorden gezegd het verwijzen naar hetzelfde in tekst.

Verwijzingen kunnen zich op vele manieren manifesteren en we gebruiken verwijzingen continu. Verwijzingen maken van losse zinnen een samenhangend verhaal en zijn essentieel voor taalbegrip. Het oplossen van coreferentie is daarom ook essentieel in onze missie.

Elementaire vormen van verwijzingen vinden plaats via aanwijzend voornaamwoorden zoals ‘die’, ‘dit’, ‘dat’ en ‘deze’. Aanwijzend voornaamwoorden kunnen verwijzen naar een enkel zelfstandig naamwoord, maar soms ook brede concepten. Vaak verwijzen we naar personen terug met ‘hij’ of ‘zij’. Verwijzing in tekst kan ook plaatsvinden in de vorm van synoniemen. Bijvoorbeeld een ‘huis’ en ‘woning’. Verwijzing kan ook plaatsvinden in de vorm van logische telling. Bijvoorbeeld “Een man en een vrouw uit Amsterdam ..” en daarna “Het tweetal ..”. Een andere belangrijke vorm van aanwijzing vindt plaats op wat kennis vereist over de persoon of ding en ook ons nieuwe verbanden leert. Bijvoorbeeld “Messi” en ‘De voetballer’, “Irene Schouten” en “De drievoudig olympisch kampioen” of “Elden Ring” en “Het spel”.

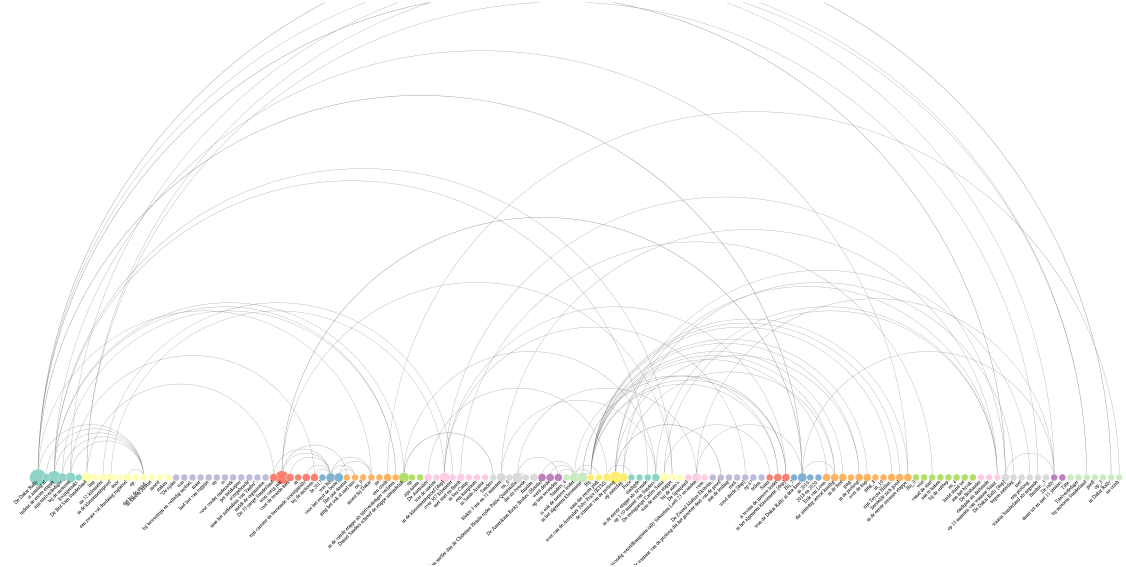

Verwijzingen kunnen dichtbij en veraf zijn. Dit duidt al op een verschil tussen ‘dit’ en ‘dat’ maar ook op verwijzingen die binnen de zin, buiten de zin en zelfs naar een andere paragraaf of gesprek verwijzen. Kortom, we verwijzen overal en op veel manieren.

In ons huidig onderzoek en ontwikkeling van Voice Marker II speelt coreferentie een essentiële rol. Met onze oplossingen voor coreferentie kunnen we de belangrijkste verbanden in tekst beter herkennen en leggen we een basis die de samenhang van een verhaal beter begrijpt om bijvoorbeeld een betere samenvatting te maken, een chatbot-gesprek beter te begrijpen en vooral ook meer kennis kan leren uit tekst op een gestructureerde manier. •

Geplaatst 01-2023 in NLP